Google hat auf seiner Hausmesse I/O neue Deep Learning-Hardware vorgestellt. Diese soll deutlich leistungsfähiger als Grafikkarten sein, benötigt dafür aber auch ein spezielles Kühlsystem. Hierbei kommt erstmals Wasser in einem eigenen Rechenzentrum zum Einsatz.

Google TPU 3.0 mit 100 Petaflops

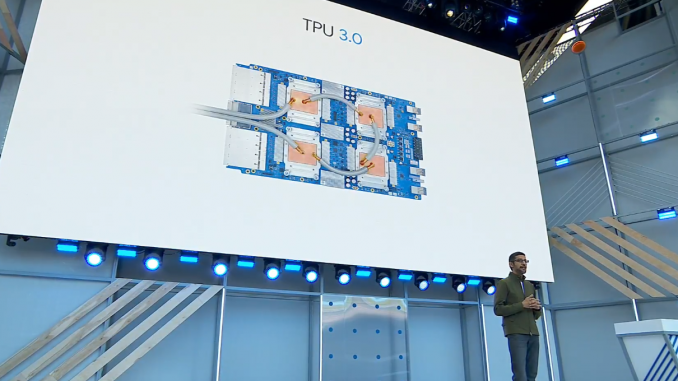

Deep Learning wird ein Thema, welches in Zukunft immer mehr unseres digitalen Lebens einnehmen wird. Google setzt daher schon seit Jahren eigene Server mit sogenannten Tensor Processing Units (TPUs) ein. Der Internetgigant entwickelt die Hardware dafür grundsätzlich selbst. Der CEO Sundar Pichai hat vor kurzem die dritte Generation der TPUs vorgestellt. Diese sollen im Vergleich zur zweiten Generation achtmal schneller sein und über 100 Petaflops an Leistung erreichen. Diese Leistung wird erreicht, indem viele Einzeleinheiten mit jeweils vier Chips zu einem „Giant Pod“ gekoppelt werden. Bereits bei der zweiten Generation erreichte eine Einheit 180 Teraflops. Zum Vergleich: eine GTX 1080 ti erreicht gut 12,2 Teraflops.

Damit baut Google den Vorsprung zu Grafikkartensystemen wie Nvidias DGX-2 weiter aus. Das DGX-2 erreicht mit 16 Stück Tesla V100 gute 2 Petaflops. Ob die Größe der Pods gestiegen ist, ist derzeit noch unklar, aber aufgrund des Namens wahrscheinlich. Ebenfalls unklar ist, wie sich die interne Struktur der TPUs geändert hat.

Google kühlt mit Wasser

Um der enormen Abwärme der Giant Pods überhaupt Herr zu werden, setzt Google bei dieser Generation auch erstmals auf ein neues Kühlsystem. Erstmals wird die Kühlung mittels Wasserblöcken und Kühlflüssigkeit realisiert. Die Wasserkühlung ist dabei direkt in den Rechenzentren installiert. Ohne dieses Kühlsystem wäre das Vorhaben wahrscheinlich auch nicht möglich. Die TPU-Server stehen in Zukunft den Cloud-Kunden zur Verfügung.

Hinterlasse jetzt einen Kommentar